ในวันที่ปัญญาประดิษฐ์ (AI) กลายเป็นหัวใจสำคัญของธุรกิจ คำถามใหญ่ที่ตามมาไม่ใช่ “เราจะใช้ AI อย่างไร?” อีกต่อไป แต่คือ “เราจะมั่นใจได้อย่างไรว่า AI ที่เราใช้นั้นปลอดภัยและเชื่อถือได้?”

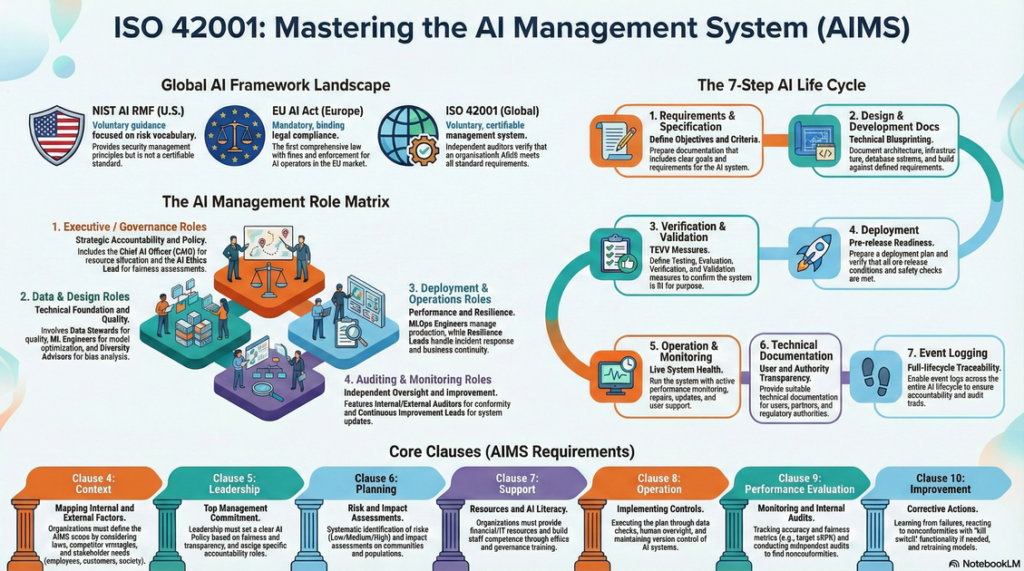

ความท้าทายนี้ทำให้เกิดมาตรฐานและกฎระเบียบขึ้นมากมายทั่วโลก จนองค์กรส่วนใหญ่อาจรู้สึกสับสนว่าจะยึดหลักเกณฑ์ไหนดี ตัวอย่างเช่น ในสหรัฐอเมริกามี NIST AI RMF ซึ่งเป็นเหมือน “คู่มือแนะนำ” ที่ดีเยี่ยมในการจัดการความเสี่ยง แต่ก็เป็นเพียงความสมัครใจ ไม่มีใครมารับรองผลให้ ในขณะที่ฝั่งยุโรปมี EU AI Act ซึ่งเป็น “กฎหมายบังคับ” ที่เข้มงวดและมีบทลงโทษรุนแรงหากฝ่าฝืน

ช่องว่างตรงนี้เองที่ทำให้ ISO/IEC 42001 ก้าวเข้ามามีบทบาทสำคัญ เพราะนี่คือ “ระบบมาตรฐานสากล” (Global Standard) ตัวแรกที่ไม่ได้เป็นแค่คำแนะนำ แต่เป็นระบบที่ “ขอการรับรองได้” (Certifiable) โดยมีผู้ตรวจสอบภายนอก (Independent Auditors) เข้ามายืนยันว่าองค์กรของคุณมีการจัดการ AI ที่ได้มาตรฐานจริง ซึ่งช่วยสร้างความเชื่อมั่นให้กับลูกค้าและคู่ค้าได้อย่างเป็นรูปธรรมที่สุด

1. ภาพรวมของมาตรการกำกับดูแล (Global Landscape)

เพื่อให้เห็นภาพชัดเจน เราสามารถแบ่งระดับการกำกับดูแล AI ในปัจจุบันออกเป็น 3 กลุ่มใหญ่ตามสถานะการบังคับใช้:

- กลุ่มแนวทางปฏิบัติ (Guidance) – NIST AI RMF: เปรียบเสมือน “คลังความรู้” เน้นเรื่องคำศัพท์เทคนิคและวิธีบริหารความเสี่ยง เหมาะสำหรับใช้ภายในองค์กรเพื่อสร้างพื้นฐาน

- กลุ่มกฎหมายบังคับ (Hard Law) – EU AI Act: เปรียบเสมือน “กฎกติกาที่ต้องทำตาม” เน้นควบคุมความปลอดภัยและสิทธิขั้นพื้นฐาน มีผลทางกฎหมายชัดเจนในยุโรป

- กลุ่มมาตรฐานระบบ (Management Standard) – ISO/IEC 42001: เปรียบเสมือน “ตราประทับรับรองคุณภาพ” เป็นจุดสมดุลที่ช่วยให้องค์กรวางระบบการทำงานที่เป็นสากล และสามารถพิสูจน์ความน่าเชื่อถือผ่านใบรับรอง (Certificate) ได้ทั่วโลก

2. หัวใจของการจัดการ: วงจร PDCA ใน ISO 42001

โครงสร้างของ ISO/IEC 42001 ออกแบบมาให้สอดคล้องกับมาตรฐานระดับโลกอื่นๆ ที่เราคุ้นเคย โดยใช้หลักการ PDCA (Plan-Do-Check-Act) เพื่อให้เกิดการพัฒนาอย่างต่อเนื่อง:

- Plan (การวางแผน – Clause 4, 5, 6): จุดเริ่มต้นคือ “ความเข้าใจ” องค์กรต้องรู้ว่า AI ของเรากระทบใครบ้าง (Stakeholders) และมีความเสี่ยงอะไร สิ่งสำคัญที่สุดคือ ผู้นำ (Leadership) ต้องเอานโยบาย AI มาผูกกับกลยุทธ์บริษัท ไม่ใช่แค่เรื่องของฝ่ายไอที และต้องมีการประเมินผลกระทบ (Impact Assessment) ก่อนเริ่มงานเสมอ

- Do (การลงมือทำ – Clause 7, 8): เมื่อมีแผนก็ต้องมี “ความพร้อม” ทั้งงบประมาณ คน และข้อมูล (Resources & Competence) รวมถึงการสร้างความตระหนักรู้ให้พนักงาน ในขั้นตอนนี้องค์กรต้องควบคุมการทำงานของ AI อย่างเคร่งครัด และมีแผนรับมือหากมีการเปลี่ยนแปลงระบบ (Change Management) เพื่อไม่ให้เกิดช่องโหว่

- Check (การตรวจสอบ – Clause 9): ระบบที่ดีต้อง “วัดผลได้” ต้องมีการติดตามดูว่า AI ทำงานแฟร์ไหม? แม่นยำไหม? โดยต้องมีการตรวจสอบภายใน (Internal Audit) และให้ผู้บริหารทบทวนผลการดำเนินงานอย่างสม่ำเสมอ

- Act (การปรับปรุง – Clause 10): ไม่มีระบบใดสมบูรณ์แบบ เมื่อเจอข้อผิดพลาดต้องรีบแก้ไขที่ต้นเหตุ (Root Cause) และปรับปรุงระบบ AIMS ให้ทันต่อเทคโนโลยีที่เปลี่ยนไปทุกวัน

3. ใครต้องรับผิดชอบอะไรบ้าง? (AI Management Roles)

เพื่อให้ระบบเดินหน้าไปได้ ISO 42001 เสนอให้แบ่งบทบาทหน้าที่ออกเป็น 4 ส่วน เพื่อให้เกิดการคานอำนาจกัน:

- สายกลยุทธ์ (Governance): เช่น Chief AI Officer คนกลุ่มนี้คือกัปตันเรือ กำหนดทิศทาง จริยธรรม และดูแลเรื่องกฎหมาย

- สายผู้สร้าง (Data & Design): เช่น Data Scientist และ AI Designer รับผิดชอบการสร้างโมเดล เตรียมข้อมูล และออกแบบระบบให้มนุษย์ยังสามารถควบคุมได้ (Human Oversight)

- สายปฏิบัติการ (Deployment & Ops): เช่น MLOps Engineer คนกลุ่มนี้ดูแลระบบหน้างานจริง การจัดซื้อ และบริหารความเสี่ยงจากผู้ให้บริการภายนอก

- สายตรวจสอบ (Audit & Monitoring): เช่น AI Auditor คนกลุ่มนี้คือ “กรรมการ” ที่คอยตรวจสอบความโปร่งใสและยืนยันความถูกต้องอย่างเป็นอิสระ

4. วงจรชีวิตของ AI ที่ตรวจสอบย้อนกลับได้ (Traceability)

อีกหนึ่งหัวใจสำคัญคือ “Traceability” หรือความสามารถในการตรวจสอบย้อนกลับ หาก AI เกิดปัญหา เราต้องรู้สาเหตุ โดยมาตรฐานกำหนดให้มีการบันทึกข้อมูลตลอด 7 ขั้นตอนของวงจรชีวิต:

- ข้อกำหนด: เราอยากได้อะไร ต้องเขียนให้ชัด

- การออกแบบ: สร้างมาแบบไหน โครงสร้างเป็นอย่างไร

- การทดสอบ: ก่อนใช้จริง ต้องผ่านการทดสอบสมรรถนะ (Verification & Validation)

- การปล่อยระบบ: เช็คความพร้อมครั้งสุดท้ายก่อน Go Live

- การใช้งานจริง: ดูแลรักษาและซ่อมบำรุงต่อเนื่อง

- คู่มือ: เอกสารแนะนำการใช้งานสำหรับคนทำงาน

- การเก็บ Log: บันทึกประวัติการทำงานไว้ตรวจสอบย้อนหลัง

บทสรุป

ISO/IEC 42001 ไม่ได้เป็นเพียงเอกสารกำกับดูแลที่ซับซ้อน แต่คือ “โครงสร้างพื้นฐานทางความเชื่อมั่น” สำหรับองค์กรในยุคดิจิทัล การนำมาตรฐานนี้มาใช้ ไม่เพียงแต่ช่วยลดความเสี่ยงทางกฎหมายและชื่อเสียง แต่ยังเป็นการประกาศให้โลกรู้ว่า องค์กรของคุณพร้อมแล้วที่จะใช้ AI ขับเคลื่อนธุรกิจอย่างมีความรับผิดชอบ โปร่งใส และยั่งยืน onconformity & Corrective Action): จัดการข้อบกพร่องที่พบและแก้ไขที่สาเหตุรากฐาน

Reference:

ISO 42001 Starter Guide_HUXAI_ResearchReport : https://www.aigl.blog/content/files/2025/11/ISO-42001-Starter-Guide.pdf